理化学研究所(理研)情報統合本部 ガーディアンロボットプロジェクト 心理プロセス研究チームの難波 修史 客員研究員、佐藤 弥 チームリーダーらの共同研究グループは、感情次元(感情が快不快と活性度の2次元で説明できるとする理論)に対応付けられ、さらに多角度と深度情報を備える表情動画のデータベースを開発しました。

これまでAI開発などのために、感情と対応付けられた表情のデータベースが公表されてきました。こうした表情データベースは、怒りや喜びといった感情カテゴリーと特定表情との対応を想定する理論に基づいていました。しかし、最近の心理学研究からは、感情カテゴリーと表情の関係は個人間や文化間でばらつきが大きく、快不快と活性度という感情次元と表情の関係の方がより普遍性を持ち得ることが指摘されてきました。

今回、共同研究グループは、日本人48人を対象として、快不快5段階×活性度5段階の計25パターンの出来事を記入してもらい、後で各出来事を思い出してその感情体験と対応する表情の表出を求めました。その際の表情を、カラーイメージ情報と3D情報を収集可能な特殊なカメラ10台で撮影し、多角度の画像および深度情報を計測しました。データを解析して感情次元と表情筋の関係を解析したところ、快不快に対応するパターン(不快で眉がしかめられ、快で口元が広がり上がるなど)が示されました。表情データベースは、学術目的で公開されます。またこのデータベースに基づいて、表情から快不快を連続的にセンシングするAIの開発を進めており、近く発表する予定です。

本研究は、科学雑誌『Scientific Reports』オンライン版(12月8日付)に掲載されました。

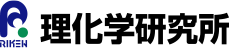

快不快と活性度で感情を表す表情の平均画像

背景

表情は感情を表現する主要メディアです。感情に応じて表情筋[1]が特有の活動パターンを示すことは、古くから指摘されてきました。

表情を解析して感情をセンシングするAIシステムができれば、主観的な状態を視認可能な情報から自動的に計測することが可能となります。そうした技術は、商品開発やメンタルヘルス改善に役立つと期待されます。そのようなAI開発のためには、感情と表情の対応を示すデータベースが必要です。

感情と対応付けられた表情のデータベースは、これまでいくつか発表されてきました。こうした表情データベースは、心理学者であるポール・エクマン博士が1970年代に提唱した、怒りや喜びといった感情カテゴリーを想定する理論に基づいていました。一方、リサ・フェルドマン・バレット博士らを中心とする最近の心理学研究は、感情カテゴリーと表情の関係は個人間や文化間でばらつきが大きく、快不快と活性度という感情次元と表情の関係の方がより普遍性を持ち得ることを指摘しています。このため、感情カテゴリーに代わる感情次元と対応付けられた表情のデータベースを開発することは急務の課題でした。

研究手法と成果

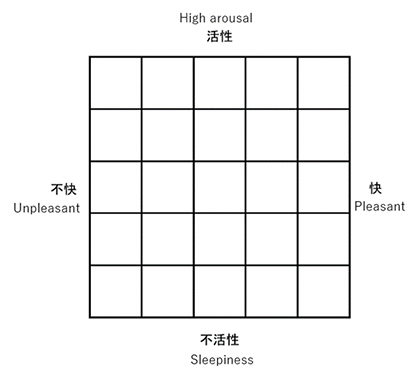

共同研究グループは、感情次元(快不快と活性度)に対応付けられ、さらに多角度と深度の情報を備えて、表情を3Dモデルとして再構成可能な表情データベースを開発することを目指しました。日本人48人に快不快5×活性度5の出来事を記入してもらい、その後それらの出来事を思い出して表情を表出することを求めました(図1)。その際、10台の特殊なカメラで表情を撮影し、多角度の画像および深度情報を計測しました(図2)。

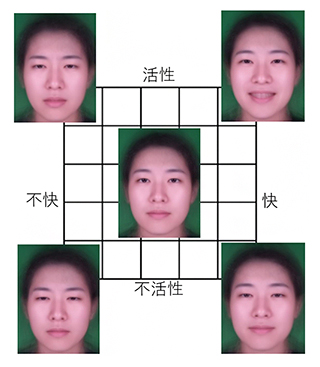

図1 感情次元に基づいて感情的な出来事を書いてもらうための枠組み

快不快5×活性度5の出来事の記入を求め、後で出来事を思い出して表情の表出を求めた。

図2 多角度と深部の表情データを計測する装置(上)とデータの例(下)

10台の特殊なカメラで多角度から撮影してそれを統合するシステムを開発し、データを同時取得した。

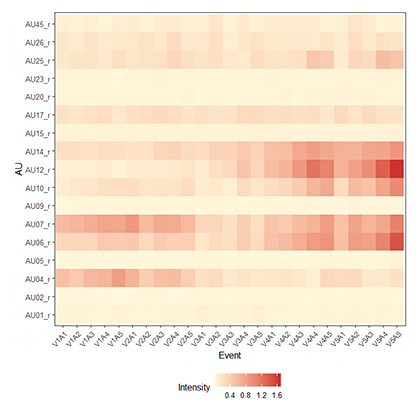

正面の画像情報をAIで解析し、顔面動作符号化法[2]と呼ばれるヒトの表情筋活動を評価する方法で定量化しました。その結果を図3に示します。アクションユニット(AU)[3]ごとに快不快および活性度との対応関係が示され、例えばAU4(眉をしかめる)が不快のときに生じ、AU12(口角を広げ上げる)が快のときに生じるなどの対応関係が分かります。

図3 感情次元(快不快5×活性度5)と表情筋活動との対応関係

横軸のEventは、快不快をvalenceの頭文字からV、活性度をarousalの頭文字Aとして記載する。快不快について1を不快、5を快とし、活性度については1が弱く、5が強い状態とする。

今後の期待

今回の研究は、感情次元と表情とを対応付けて複数の視点から撮影された、日本人の動的表情データベースとして世界初の成果です。感情次元と特定の表情筋活動に対応関係があるという知見は、従来の心理学理論からも裏付けられています。表情データベースは、多角度と深部の情報を備える表情動画であることから、心理学研究のみならず、工学的応用にも役立つと考えられます。

今回の成果は、表情から感情次元をセンシングするAI開発にも貢献すると期待されます。共同研究グループでもそのようなAI開発に取り組んでおり、このデータベースに基づいて、表情から快不快を連続的にセンシングするAIを近く発表する予定です。

補足説明

- 1.表情筋

顔の表情を作る筋肉の総称で、顔面筋とも呼ばれる。ヒトの顔には、眼輪筋、前頭筋、鼻筋、口輪筋など、数十以上の表情筋があるとされる。 - 2.顔面動作符号化法

ヒトの顔の動きの有無や強度を、視覚情報に基づいて評価するシステム。ポール・エクマン博士らが解剖学に基づいて体系立てた。 - 3.アクションユニット(AU)

顔面動作符号化法での評価の基となる、特定の表情筋や表情筋肉群の活動量。本研究では主要な17項を抜粋し使用した。

共同研究グループ

理化学研究所 情報統合本部 ガーディアンロボットプロジェクト

心理プロセス研究チーム

客員研究員 難波 修史(ナンバ・シュウシ)

(広島大学 大学院人間社会科学研究科 准教授)

チームリーダー 佐藤 弥(サトウ・ワタル)

研究パートタイマーⅠ(研究当時)難波 紗央里(ナンバ・サオリ)

テクニカルスタッフⅠ 下川 航(シモカワ・コオ)

(小日向合同会社にも所属)

京都工芸繊維大学 情報工学・人間科学系

准教授 野宮 浩揮(ノミヤ・ヒロキ)

小日向合同会社

代表 大角 将樹(オオスミ・マサキ)

研究支援

本研究は科学技術振興機構(JST)未来社会創造事業「世界一の安全・安心社会の実現」領域の「表情からの感情センシングによるウェルビーイング向上(研究代表者:佐藤弥、JPMJMI20D7)」および公益財団法人電気通信普及財団研究調査助成「仮想空間社会の実現に向けた表情データベースの構築および表情検出システムの開発」の助成を受けて実施されました。

原論文情報

- Namba, S., Sato, W., Namba, S., Nomiya, H., Shimokawa, K., & Osumi, M., "Development of the RIKEN database for dynamic facial expressions with multiple angles", Scientific Reports, 10.1038/s41598-023-49209-8

発表者

理化学研究所

情報統合本部 ガーディアンロボットプロジェクト 心理プロセス研究チーム

チームリーダー 佐藤 弥(サトウ・ワタル)

客員研究員 難波 修史(ナンバ・シュウシ)

佐藤 弥

佐藤 弥

報道担当

理化学研究所 広報室 報道担当

お問い合わせフォーム