自律的に振る舞い、自然言語で会話もできるAI搭載ロボットが日常生活や仕事の幅広いシーンで活躍しています。こうした社会性を持ったロボットが設計者の意図にない振る舞いをした場合、誰がどこまで責任を負うべきなのか。AI・ロボット研究の分野では、これまでのような人間中心の価値観や倫理観が通用しない領域が生まれつつあります。AI・ロボットの倫理について、革新知能統合研究センター(AIP)の水上 拓哉 特別研究員に話を聞きました。

ロボットの倫理的な設計論を考察する

2016年、MicrosoftがSNS上で公開したチャットボット「Tay(テイ)」が話題になった。チャットボットとは、いわゆる「対話システム」の総称で、Tayもユーザーが会話を楽しむために設計・開発されたものだ。しかし、公開されるやいなや差別的投稿などを繰り返すようになり、リリースのわずか16時間後にサービス停止となった。これは、悪意のあるユーザーから送られてきたツイート内容を多数"学習"してしまったことが原因とされている。

時は流れ、2023年。ChatGPTに代表される生成AIの登場もあり、チャットボットは社会のさまざまな場所で活用されている。今や少なからぬ社会的影響力を持つようになったチャットボットの発話について、設計者はどこまで責任を負うべきなのか?水上 特別研究員はこうした問題に技術哲学・技術倫理の観点から向き合っている。「私の専門は、ソーシャルロボットの倫理です。AIを搭載したロボットの倫理的な設計論を考察しています」

間違った行動をとる主体は誰なのか?

ソーシャルロボットとは、「何らかの社会的な役割を持つことを目的に開発された自律型ロボット」のことを指す。ChatGPTのような対話システムも広義のソーシャルロボットとして、水上 特別研究員の研究対象になる。現在の生成型の対話システムは質の高い発話をつくることが可能だが、それは統計的に生成されたものにすぎず、ときにはシステムが「ウソをつく」場合もある。あらかじめプログラムされていない不適切な発話のすべてに開発者が道徳的責任を負うことは難しい。

だが、チャットボットによってユーザーがだまされたり、傷ついたりするような事態が起こった場合、誰かが責任を負うべきだという議論が生じるのは当然だろう。ポイントは「道徳的行為者性」、つまり、正しい/間違った行動をとる主体は誰か、という問題だ。「技術哲学・技術倫理の世界では、これまでもロボットのような技術的人工物に道徳的行為者性をどこまで持たせるべきかという議論がされてきました。これは、機械が道徳的な良し悪しや価値判断をする能力を持つかどうかを考える指針のようなものです」

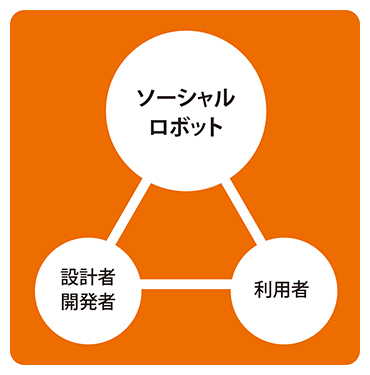

「人間中心主義」に基づく旧来の倫理学では、道徳的行為者性を持つのは、人間だけだと考えられてきた。しかし、21世紀以降の技術哲学・技術倫理の世界では、この考え方を捉え直す潮流が生まれつつある。「対話システムにおいては、道徳的責任を考える上で、設計者以外のユーザーが果たす役割も大きいですよね。設計者の意図を超えた使い方をしても止めることはできない。そこで、人間とソーシャルロボットが一緒になった"結合体"として行為者になる(図1)という観点で、道徳的責任を考える新たな指針を検討しています」

図1 "結合体"としての道徳的行為者性を考える

人間とソーシャルロボットの"結合体"を行為者として、道徳的責任を考える。

「つくる側」の指針を提示し、研究促進につなげたい

水上 特別研究員がロボットに興味を持ったのは、幼稚園児の頃。大好きだったゲームに登場するロボットが、突如消えてしまったことに傷つき、大泣きしたことがあったという。ゲームの設定によって架空の親友を失った水上 少年は、中学生になると、ロボットと会話するプログラムを自らつくろうと決意。そして、大学入学後、本格的にロボットの研究を始めた。「大学の学部時代は、『心』をプログラムで実現できるか…といった開発側の研究をしていました。その後、大学院の修士過程で技術哲学・技術倫理の領域に興味を持つようになり、主にソーシャルロボットを対象とした倫理の研究に至りました」

水上 特別研究員は現在、AIPに所属しながら、複数の大学で教壇にも立つ。最近は、学生と共にChatGPTを扱う中で、使い手の側にも改善する余地があると感じている。「生成AIに頼りすぎるのも問題ですが、頼れる存在として使いこなせている人もまだ少ないのでは、と感じています」

さらに、国産のペット型ロボットのオーナーを対象とした調査も計画中だ。その狙いは、ロボットのもたらす客観的効用の測定ではなく、むしろユーザーがロボットのイメージをつくり上げる主観的なプロセスの理解にある。「ユーザーの中には、ペット型ロボットが動かなくなったら、お葬式をする人もいます。個人個人がロボットとの関係をどう意味付けるかを知ることは、人間そのものの理解にもつながる可能性があります」

社会で広くAIが活用されるようになり、個人情報保護などの面で不安を感じながら仕事をしている開発者も多い。そこで、「つくる側」に明確な指針を提示し、「AI研究の促進」につなげることこそ使命だと捉える。「AIやソーシャルロボットの倫理は、関係者がみんなでつくっていくものだと思っています。これを実現するため、AIPを拠点に技術哲学・技術倫理の研究者、AI・ロボットの開発者、そして、教育学や社会学など応用領域の研究者まで広がる研究コミュニティを形成するのが今の目標です」

(取材・構成:丸茂 健一/撮影:相澤 正。/制作協力:サイテック・コミュニケーションズ)

この記事の評価を5段階でご回答ください